–іҲУ–ЎӮЙҒuBlenderҒENeRFҒv

https://github.com/maximeraafat/BlenderNeRF

ҸӯӮөҲнӮкӮйӮӘҒAӮұӮҝӮзӮаҺQҚlӮЙӮИӮйҒB

https://qiita.com/live2d_dev/items/7e1628670f299036cf5f

ҺҹӮНӮұӮкӮ©ҒI

Blender json ғtғ@ғCғӢҗ¶җ¬ғeғXғgҒF

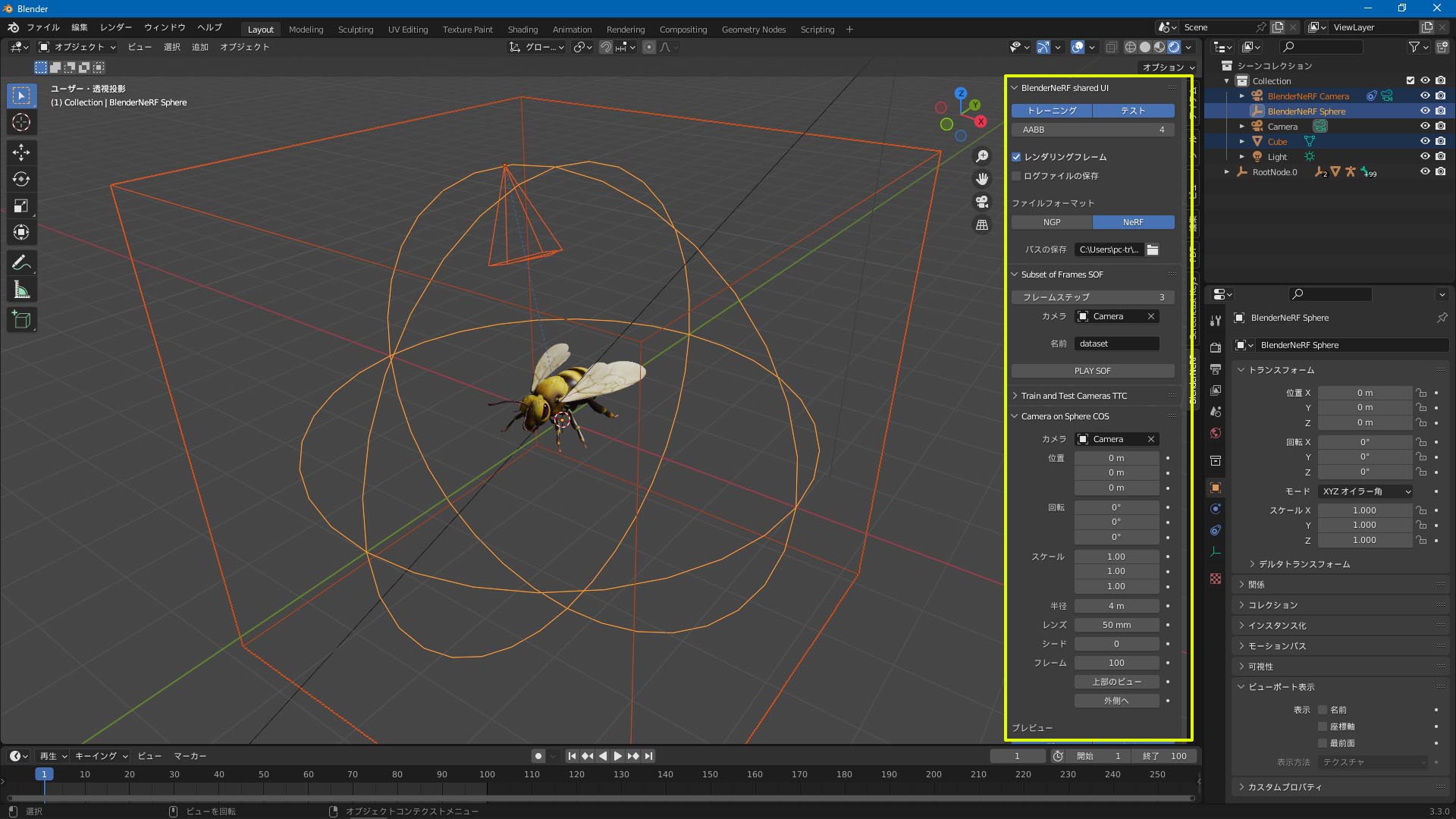

ғJғҒғү PLAY COSҒi’Іҗ®–іӮөҒjҺАҚsҺһӮМ—lҺq

ғҢғ“ғY50mmҒA”јҢa4mҒA100ғtғҢҒ[ғҖ

ғvғүғOғCғ“ҒEDocumentsҒi”ІҗҲҒj

ғҒғ\ғbғhӮМҺg—p•ы–@

ғAғhғIғ“ӮМғvғҚғpғeғB ғpғlғӢӮНҒAҲИүәӮЕҺg—pӮЕӮ«ӮЬӮ·3D View > N panel > BlenderNeRF( N ғpғlғӢӮНҒA ӮрүҹӮ·ӮЖ 3D ғrғ…Ғ[ғ|Ғ[ғgӮЕғAғNғZғXӮЕӮ«ӮЬӮ·N)ҒB3 ӮВӮМғҒғ\ғbғh ( SOFҒATTC ҒAӮЁӮжӮСCOSBlenderNeRF shared UI ) ӮНӮ·ӮЧӮДҒAҲИүәӮЙғҠғXғgӮіӮкӮДӮўӮйҗ§ҢдүВ”\ӮИғvғҚғpғeғBӮрҠЬӮЮӢӨ’КӮМғ^ғuӮрӢӨ—LӮөӮЬӮ·ҒB

Train(ғfғtғHғӢғgӮЕ—LҢш) : ғgғҢҒ[ғjғ“ғOғfҒ[ғ^ (ғҢғ“ғ_ғҠғ“ғO + ғJғҒғүҸо•с) Ӯр“oҳ^Ӯ·ӮйӮ©ӮЗӮӨӮ©

Test(ғfғtғHғӢғgӮЕ—LҢш) : ғeғXғgғfҒ[ғ^(ғJғҒғүҸо•сӮМӮЭ)Ӯр“oҳ^Ӯ·ӮйӮ©ӮЗӮӨӮ©

AABB(ғfғtғHғӢғgӮЕӮН4ӮЙҗЭ’иӮіӮкӮДӮўӮЬӮ·): ғCғ“ғXғ^ғ“ғg NGP ӮЕҗа–ҫӮіӮкӮДӮўӮй aabb ғXғPҒ[ғӢ ғpғүғҒҒ[ғ^Ғ[ (ҸЪҚЧӮНҲИүәӮрҺQҸЖ)

Render Frames(ғfғtғHғӢғgӮЕ—LҢш) : ғtғҢҒ[ғҖӮрғҢғ“ғ_ғҠғ“ғOӮ·ӮйӮ©ӮЗӮӨӮ©

Save Log File(ғfғtғHғӢғgӮЕӮН–іҢш) : BlenderNeRF ӮМҺАҚsӮЙҠЦӮ·ӮйҚДҢ»җ«Ҹо•сӮрҠЬӮЮғҚғO ғtғ@ғCғӢӮр•Ы‘¶Ӯ·ӮйӮ©ӮЗӮӨӮ©

File Format(ғfғtғHғӢғgӮЕӮНNGP ) : ғCғ“ғXғ^ғ“ғg NGP ӮЬӮҪӮНғfғtғHғӢғgӮМ NeRF ғtғ@ғCғӢҢ`Һ®ӢK‘ҘӮЕғJғҒғү ғtғ@ғCғӢӮрғGғNғXғ|Ғ[ғgӮ·ӮйӮ©ӮЗӮӨӮ©

Save Path(ғfғtғHғӢғgӮЕӮНӢу) : ғfҒ[ғ^ғZғbғgӮӘҚмҗ¬ӮіӮкӮйҸo—НғfғBғҢғNғgғҠӮЦӮМғpғX

AABBӮН 2 ӮМҗ®җ”ҸжӮЙҗ§ҢАӮіӮкӮДӮЁӮиҒANeRF ӮӘҢхҗьӮр’ЗҗХӮ·ӮйғoғEғ“ғfғBғ“ғO ғ{ғbғNғX ғ{ғҠғ…Ғ[ғҖӮМ•УӮМ’·ӮіӮр’иӢ`ӮөӮЬӮ·ҒBӮұӮМғvғҚғpғeғBӮНҒANVIDIA ӮМInstant NGPғoҒ[ғWғҮғ“ӮМ NeRF ӮЕ“ұ“ьӮіӮкӮЬӮөӮҪҒB

ғvғҚғpғeғBӮНNGPӮЬӮҪӮНNeRFFile FormatӮМӮўӮёӮкӮ©ӮЙӮИӮиӮЬӮ·ҒBNGPғtғ@ғCғӢҢ`Һ®ӮМӢK‘ҘӮНNeRFӮМӢK‘ҘӮЖ“ҜӮ¶ӮЕӮ·ӮӘҒAInstant NGPӮЕғAғNғZғXӮЕӮ«Ӯй’ЗүБғpғүғҒҒ[ғ^Ғ[ӮӘӮўӮӯӮВӮ©Ӯ ӮиӮЬӮ·ҒB

ҠeғҒғ\ғbғhӮЙӮНҒAғfҒ[ғ^ғZғbғg–јӮЖӮ»ӮкӮјӮкӮМғҒғ\ғbғhӮЕҚмҗ¬ӮіӮкӮҪZIPNameғtғ@ғCғӢ–јӮЙ‘ОүһӮ·ӮйҢЕ—LӮМғvғҚғpғeғB (ғfғtғHғӢғgӮЕ ӮЙҗЭ’и)ӮӘӮ ӮйӮұӮЖӮЙ’ҚҲУӮөӮДӮӯӮҫӮіӮўҒBғXғyҒ[ғXӮв ӮИӮЗӮМғTғ|Ғ[ғgӮіӮкӮДӮўӮИӮў•¶ҺҡӮНҒAҺ©“®“IӮЙғAғ“ғ_Ғ[ғXғRғAӮЙ’uӮ«Ҡ·ӮҰӮзӮкӮйӮұӮЖӮЙ’ҚҲУӮөӮДӮӯӮҫӮіӮўҒBdataset#/

ҲИүәӮЙҒAҠeғҒғ\ғbғhӮЙҢЕ—LӮМғvғҚғpғeғBӮЙӮВӮўӮДҗа–ҫӮөӮЬӮ· (NameӮ·ӮЕӮЙҸгӮЕҗа–ҫӮөӮҪӮҪӮЯҒAғvғҚғpғeғBӮНҸИ—ӘӮіӮкӮДӮўӮЬӮ·)ҒB

SOFӮМӮвӮи•ы

Frame Step(ғfғtғHғӢғgӮЕӮН3ӮЙҗЭ’иӮіӮкӮДӮўӮЬӮ·) : N (җЭ’иғZғNғVғҮғ“ӮЕ’иӢ`) = ғgғҢҒ[ғjғ“ғO ғtғҢҒ[ғҖӮӘ“oҳ^ӮіӮкӮй•p“x

Camera(ҸнӮЙғAғNғeғBғuӮИғJғҒғүӮЙҗЭ’иӮіӮкӮЬӮ·) : ғgғҢҒ[ғjғ“ғOӮЁӮжӮСғeғXғg ғfҒ[ғ^ӮМ“oҳ^ӮЙҺg—pӮіӮкӮйғJғҒғү

PLAY SOF: Subset of FramesғҒғ\ғbғh ғIғyғҢҒ[ғ^ӮрҚДҗ¶ӮөӮД NeRF ғfҒ[ғ^ӮрғGғNғXғ|Ғ[ғgӮөӮЬӮ·

TTCӮМӮвӮи•ы

Frames(ғfғtғHғӢғgӮЕӮН100ӮЙҗЭ’иӮіӮкӮДӮўӮЬӮ·) : ғgғҢҒ[ғjғ“ғO ғJғҒғүӮ©ӮзҺg—pӮіӮкӮйғgғҢҒ[ғjғ“ғO ғtғҢҒ[ғҖӮМҗ”

Train Cam(ғfғtғHғӢғgӮЕӮНӢу) : ғgғҢҒ[ғjғ“ғOғfҒ[ғ^ӮМ“oҳ^ӮЙҺg—pӮіӮкӮйғJғҒғү

Test Cam(ғfғtғHғӢғgӮЕӮНӢу) : ғeғXғgғfҒ[ғ^ӮМ“oҳ^ӮЙҺg—pӮіӮкӮйғJғҒғү

PLAY TTC:ғJғҒғүӮМғgғҢҒ[ғjғ“ғOӮЖғeғXғgғҒғ\ғbғh ғIғyғҢҒ[ғ^Ғ[ӮрҚДҗ¶ӮөӮДҒANeRF ғfҒ[ғ^ӮрғGғNғXғ|Ғ[ғgӮөӮЬӮ·ҒB

FramesTrain CamғVҒ[ғ“ӮМҠJҺnғtғҢҒ[ғҖӮ©ӮзҠJҺnӮөӮДҒAғIғuғWғFғNғgӮрҺg—pӮөӮДғgғҢҒ[ғjғ“ғO ғtғҢҒ[ғҖӮМ—КӮӘғLғғғvғ`ғғӮіӮкӮЬӮ·ҒB

COSӮМӮвӮи•ы

Camera(ҸнӮЙғAғNғeғBғuӮИғJғҒғүӮЙҗЭ’иӮіӮкӮЬӮ·) : ғeғXғgғfҒ[ғ^ӮМ“oҳ^ӮЙҺg—pӮіӮкӮйғJғҒғү

Location(ғfғtғHғӢғgӮЕӮН0 mғxғNғgғӢӮЙҗЭ’иӮіӮкӮДӮўӮЬӮ·) : ғJғҒғү ғrғ…Ғ[ӮӘғTғ“ғvғҠғ“ғOӮіӮкӮйғgғҢҒ[ғjғ“ғOӢ…ӮМ’ҶҗSҲК’u

Rotation(ғfғtғHғӢғgӮЕӮН0ҒӢғxғNғgғӢӮЙҗЭ’иӮіӮкӮДӮўӮЬӮ·) : ғJғҒғү ғrғ…Ғ[ӮӘғTғ“ғvғҠғ“ғOӮіӮкӮйғgғҢҒ[ғjғ“ғOӢ…ӮМүс“]

Scale(ғfғtғHғӢғgӮЕӮН1ғxғNғgғӢӮЙҗЭ’иӮіӮкӮДӮўӮЬӮ·) : xyz ҺІӮМғgғҢҒ[ғjғ“ғOӢ…ӮМғXғPҒ[ғӢ ғxғNғgғӢ

Radius(ғfғtғHғӢғgӮЕӮН4 mӮЙҗЭ’иӮіӮкӮДӮўӮЬӮ·) : ғgғҢҒ[ғjғ“ғOӢ…ӮМ”јҢaғXғJғүҒ[

Lens(ғfғtғHғӢғgӮЕӮН50 mmӮЙҗЭ’иӮіӮкӮДӮўӮЬӮ·) : ғgғҢҒ[ғjғ“ғO ғJғҒғүӮМҸЕ“_Ӣ——Ј

Seed(ғfғtғHғӢғgӮЕӮН0ӮЙҗЭ’иӮіӮкӮЬӮ·) : ғүғ“ғ_ғҖӮИғJғҒғүғrғ…Ғ[ӮМғTғ“ғvғҠғ“ғOҺиҸҮӮрҸүҠъү»Ӯ·ӮйӮҪӮЯӮМғVҒ[ғh

Frames(ғfғtғHғӢғgӮЕӮН100ӮЙҗЭ’иӮіӮкӮДӮўӮЬӮ·): ғgғҢҒ[ғjғ“ғOӢ…Ӯ©ӮзғTғ“ғvғҠғ“ғOӮЁӮжӮСғҢғ“ғ_ғҠғ“ғOӮіӮкӮҪғgғҢҒ[ғjғ“ғO ғtғҢҒ[ғҖӮМҗ”

Sphere(ғfғtғHғӢғgӮЕӮН–іҢш) : ғүғ“ғ_ғҖӮИғrғ…Ғ[ӮӘғTғ“ғvғҠғ“ғOӮіӮкӮйғgғҢҒ[ғjғ“ғOӢ…Ӯр•\ҺҰӮ·ӮйӮ©ӮЗӮӨӮ©

Camera(ғfғtғHғӢғgӮЕӮН–іҢш) : ҠwҸKғfҒ[ғ^ӮМ“oҳ^ӮЙҺg—pӮөӮҪғJғҒғүӮр•\ҺҰӮ·ӮйӮ©ӮЗӮӨӮ©

Upper Views(ғfғtғHғӢғgӮЕӮН–іҢш) : Ҹг•”ғgғҢҒ[ғjғ“ғO”јӢ…ӮМӮЭӮ©Ӯзғrғ…Ғ[ӮрғTғ“ғvғҠғ“ғOӮ·ӮйӮ©ӮЗӮӨӮ© (үс“]ғoғҠғAғ“ғg)

Outwards(ғfғtғHғӢғgӮЕӮН–іҢш) : ғJғҒғүӮрғgғҢҒ[ғjғ“ғOӢ…ӮМҠO‘ӨӮЙҢьӮҜӮйӮ©ӮЗӮӨӮ©

PLAY COS: Camera on SphereғҒғ\ғbғh ғIғyғҢҒ[ғ^ӮрҚДҗ¶ӮөӮД NeRF ғfҒ[ғ^ӮрғGғNғXғ|Ғ[ғgӮөӮЬӮ·

SphereғvғҚғpғeғBӮЖCameraғvғҚғpғeғBӮрғAғNғeғBғuӮЙӮ·ӮйӮЖҒAӮ»ӮкӮјӮкBlenderNeRF SphereӢуӮМғIғuғWғFғNғgӮЖBlenderNeRF CameraғJғҒғү ғIғuғWғFғNғgӮӘҚмҗ¬ӮіӮкӮйӮұӮЖӮЙ’ҚҲУӮөӮДӮӯӮҫӮіӮўҒBғAғhғIғ“ӮМӢ@”\ӮӘүуӮкӮйүВ”\җ«ӮӘӮ ӮйӮҪӮЯҒAӮұӮкӮзӮМ–ј‘OӮМғIғuғWғFғNғgӮрҺи“®ӮЕҚмҗ¬ӮөӮИӮўӮЕӮӯӮҫӮіӮўҒB

FramesBlenderNeRF CameraғVҒ[ғ“ӮМҠJҺnғtғҢҒ[ғҖӮ©ӮзҠJҺnӮөӮДҒAғIғuғWғFғNғgӮрҺg—pӮөӮДғgғҢҒ[ғjғ“ғO ғtғҢҒ[ғҖӮМ—КӮӘғLғғғvғ`ғғӮіӮкӮЬӮ·ҒBҚЕҢгӮЙҒAғgғҢҒ[ғjғ“ғO ғJғҒғүӮНҸҠ’иӮМҲК’uӮЙғҚғbғNӮіӮкӮДӮЁӮиҒAҺи“®ӮЕҲЪ“®ӮЕӮ«ӮИӮўӮұӮЖӮЙ’ҚҲУӮөӮДӮӯӮҫӮіӮўҒB

ҚЕ“KӮИҢӢүКӮр“ҫӮйӮҪӮЯӮМғqғ“ғg

NVIDIA ӮНҒA Instant NGPӮрҺg—pӮөӮД NeRF ғӮғfғӢӮрғgғҢҒ[ғjғ“ғOӮ·Ӯй•ы–@ӮЙҠЦӮ·Ӯй–р—§ӮВғqғ“ғgӮрӮўӮӯӮВӮ©’сӢҹӮөӮДӮўӮЬӮ·ҒBӮіӮзӮЙҸЪӮөӮўғTғ|Ғ[ғgӮӘ•K—vӮИҸкҚҮӮНҒAӮЁӢCҢyӮЙғҠғ|ғWғgғҠӮЙғAғNғZғXӮөӮДӮӯӮҫӮіӮўҒBҲИүәӮНҒAҢВҗl“IӮИҢoҢұӮ©Ӯз“ҫӮҪҒAҚЕ“KӮИғiҒ[ғtӮМӮҪӮЯӮМҠИ’PӮИғqғ“ғgӮЕӮ·ҒB

NeRF ӮН 50 Ғ` 150 –ҮӮМүж‘ңӮЕҚЕ“KӮЙғgғҢҒ[ғjғ“ғOӮөӮЬӮ·

ғeғXғg ғrғ…Ғ[ӮНғgғҢҒ[ғjғ“ғO ғrғ…Ғ[Ӯ©Ӯз‘еӮ«ӮӯҲн’EӮөӮДӮНӮИӮиӮЬӮ№Ӯс

ғVҒ[ғ“ӮМ“®Ӯ«ҒAғӮҒ[ғVғҮғ“ғuғүҒ[ҒAӮЬӮҪӮНғuғүҒ[ғAҒ[ғeғBғtғ@ғNғgӮЙӮжӮиҒAҚДҚ\’zӮМ•iҺҝӮӘ’бүәӮ·ӮйүВ”\җ«ӮӘӮ ӮиӮЬӮ·

ғLғғғvғ`ғғӮіӮкӮҪғVҒ[ғ“ӮНғJғҒғүӮ©ӮзҸӯӮИӮӯӮЖӮа 1 ӮВӮМ Blender ғҶғjғbғg—ЈӮкӮДӮўӮй•K—vӮӘӮ ӮиӮЬӮ·

AABBғVҒ[ғ“ӮМғXғPҒ[ғӢӮЙӮЕӮ«ӮйӮҫӮҜӢЯӮГӮҜӮДӮӯӮҫӮіӮўҒB’lӮӘ‘еӮ«ӮўӮЖғgғҢҒ[ғjғ“ғOӮӘ’xӮӯӮИӮиӮЬӮ·ҒB

AABBҚДҚ\җ¬ӮМ•iҺҝӮӘӮЪӮвӮҜӮДҢ©ӮҰӮйҸкҚҮӮНҒA 2 ӮМӮЧӮ«ҸжӮрҲЫҺқӮөӮИӮӘӮз’Іҗ®ӮөӮДӮӯӮҫӮіӮўҒB

ғAғjғҒҒ[ғVғҮғ“’ҶӮЙғJғҒғүӮМҸЕ“_Ӣ——ЈӮр’Іҗ®Ӯ·ӮйӮұӮЖӮН”рӮҜӮДӮӯӮҫӮіӮўҒB’КҸнӮМ NeRF ғҒғ\ғbғhӮН•Ўҗ”ӮМҸЕ“_Ӣ——ЈӮрғTғ|Ғ[ғgӮөӮДӮўӮЬӮ№ӮсҒB

ӢЙ’[ӮИҸЕ“_Ӣ——ЈӮН”рӮҜӮДӮӯӮҫӮіӮўҒBҺАҚЫӮЙӮН 30 mm Ғ` 70 mm ӮМ’lӮӘ“KҗШӮЕӮ·ҒB

ғJғҒғүVerticalғZғ“ғTҒ[ӮМғtғBғbғgӮЙӮжӮиҒANeRF ғ{ғҠғ…Ғ[ғҖӮӘҳcӮЮҸкҚҮӮӘӮ ӮиӮЬӮ·ҒBүВ”\ӮЕӮ ӮкӮОүс”рӮөӮДӮӯӮҫӮіӮўҒB

NeRFӮМӮвӮи•ы

NVIDIA GPU ӮЙғAғNғZғXӮЕӮ«ӮйҸкҚҮӮНҒAғҠғ|ғWғgғҠӮЙӢLҚЪӮіӮкӮДӮўӮйҺиҸҮӮЙҸ]ӮБӮДҒAҚЕ“KӮИғҶҒ[ғUҒ[ ғGғNғXғyғҠғGғ“ғXӮр“ҫӮйӮҪӮЯӮЙҺ©•ӘӮМғfғoғCғXӮЙInstant NGPӮрғCғ“ғXғgҒ[ғӢӮ·ӮйӮЖӮжӮўӮЕӮөӮеӮӨҒBӮ»ӮкҲИҠOӮМҸкҚҮӮНҒAGoogle ғAғJғEғ“ғgӮрҺg—pӮөӮДҒAGoogle GPU ҸгӮМ COLAB ғmҒ[ғgғuғbғNӮЕ NeRF Ӯр–і—ҝӮЕҺАҚsӮЕӮ«ӮЬӮ·ҒB

ӮұӮМCOLAB ғmҒ[ғgғuғbғN(ӮұӮҝӮзӮ©ӮзӮағ_ғEғ“ғҚҒ[ғhүВ”\) ӮрҠJӮ«ҒAҺwҺҰӮЙҸ]ӮўӮЬӮ·ҒB

”хҚl

ӮұӮМғAғhғIғ“ӮНҒAҺеӮЙ macOS ҸгӮЕҒAҗ”Ӯ©ҢҺӮЁӮжӮС Blender ӮМғoҒ[ғWғҮғ“ӮрӮ©ӮҜӮДҠyӮөӮўғTғCғh ғvғҚғWғFғNғgӮЖӮөӮДҠJ”ӯӮіӮкӮДӮўӮЬӮ·ҒBғvғүғOғCғ“ӮМӢ@”\ӮЕ–в‘иӮӘ”ӯҗ¶ӮөӮҪҸкҚҮӮНҒA–в‘иӮМ–ҫҠmӮИҗа–ҫҒA–в‘иӮӘ”ӯҗ¶ӮөӮҪBlenderNeRF ӮМғoҒ[ғWғҮғ“ҒAӮЁӮжӮСҠЦҳAӮ·ӮйҸкҚҮӮНҸЪҚЧҸо•сӮр“YӮҰӮДҒAӮЁӢCҢyӮЙ GitHub ӮМғCғVғ…Ғ[ӮрҠJӮўӮДӮӯӮҫӮіӮўҒB

Ң»ҺАҗўҠEӮМғfҒ[ғ^

ӮұӮМҠg’ЈӢ@”\ӮНҚҮҗ¬ғfҒ[ғ^ғZғbғgӮМҚмҗ¬Ӯр–Ъ“IӮЖӮөӮДӮўӮЬӮ·ӮӘҒAҢ»ҺАҗўҠEӮМғJғҒғүӮ©ӮзғӮҒ[ғVғҮғ“ ғgғүғbғLғ“ғO ғfҒ[ғ^ӮрғCғ“ғ|Ғ[ғgӮ·ӮйӮҪӮЯӮМҠщ‘¶ӮМғcҒ[ғӢӮа—ҳ—pӮЕӮ«ӮЬӮ·ҒBӮ»ӮМӮжӮӨӮИ—бӮМ 1 ӮВӮӘShopifyӮМTrackyӮЕӮ·ҒBӮұӮкӮНҒAғIҒ[ғvғ“ғ\Ғ[ғX iOS ғAғvғҠӮЖҒAiPhone ҸгӮМ ARKit ғZғbғVғҮғ“Ӯ©ӮзӮМғӮҒ[ғVғҮғ“ ғgғүғbғLғ“ғO ғfҒ[ғ^ӮрӢLҳ^Ӯ·Ӯй—ЧҗЪӮ·Ӯй Blender ғvғүғOғCғ“ӮЕӮ·ҒBӮҪӮҫӮөҒA’ЗҗХғfҒ[ғ^ӮЙӮНғhғҠғtғgӮв•sҗіҠmҗ«ӮӘҗ¶Ӯ¶ӮйүВ”\җ«ӮӘӮ ӮиҒAҢӢүКӮЖӮөӮД“ҫӮзӮкӮй NeRF ҚДҚ\җ¬ӮМ•iҺҝӮЙүeӢҝӮр—^ӮҰӮйүВ”\җ«ӮӘӮ ӮйӮұӮЖӮЙ’ҚҲУӮөӮДӮӯӮҫӮіӮўҒB

Ҳш—p

ӮұӮМғҠғ|ғWғgғҠӮӘҢӨӢҶӮЙ–р—§ӮВӮЖҺvӮнӮкӮйҸкҚҮӮНҒAҸгӮМҗк—pӮМ GitHub ғ{ғ^ғ“ӮрҺg—pӮөӮДBlenderNeRFӮрҲш—pӮ·ӮйӮұӮЖӮрҢҹ“ўӮөӮДӮӯӮҫӮіӮўҒBӮұӮМҠg’ЈӢ@”\ӮрҢ|Ҹp“IӮИғvғҚғWғFғNғgӮЙҺg—pӮөӮҪҸкҚҮӮНҒAғ\Ғ[ғVғғғӢ ғҒғfғBғAӮМғnғbғVғ…ғ^ғOӮрҺg—pӮөӮДҚм•iӮМҲк•”ӮрҺ©—RӮЙӢӨ—LӮөӮДӮӯӮҫӮіӮў#blendernerfҒB:)

“Y•tғtғ@ғCғӢ